[ 매드타임스 최승은 기자] 챗GPT, Stable Diffusion, Midjourney, DALL-E 2. 최근에 일반 대중의 주의까지 끌고 있는 생성형 AI이다. 이러한 AI 도구가 급속도로 대중화되고 있지만, 이와 맞물려 규제, 법률 및 온라인 개인 정보 보호 등에서 문제가 발생하고 있다. 이미 생성형 AI의 기능을 이용해 범죄를 저지르고 허위 정보를 유포하고 있는 악의적인 사용자가 생겨났다. 그러나 이러한 속도를 정부는 따라가지 못하고 있고, 기업은 개인 사용자에게 책임을 전가하고 있다.

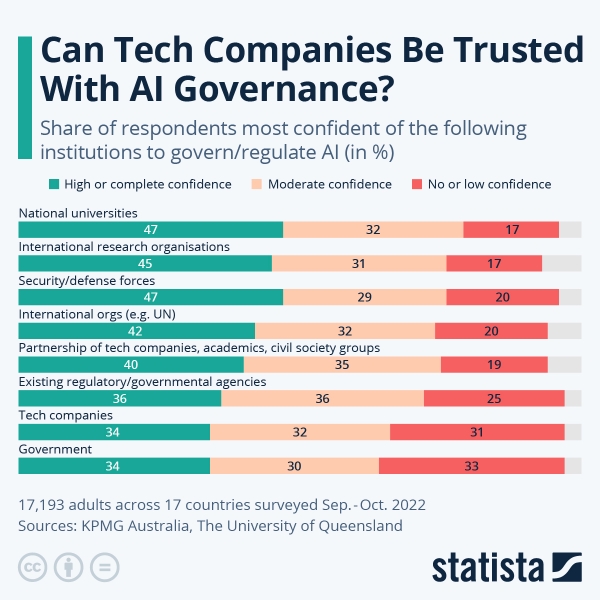

이런 가운데 일반 대중은 이미 AI 구현을 감독하는 정부 기관을 신뢰하지 않고 있다.

스태티스타가 공유한 KPMG 오스트레일리아와 퀸즐랜드 대학교가 17개국 17,000명 이상을 대상으로 실시한 조사에 따르면, 응답자의 1/3만이 AI 도구 및 시스템의 규제 및 거버넌스와 관련하여 정부를 매우 신뢰하거나 전적으로 신뢰한다고 답했다. 설문조사 참가자들은 기술 기업과 기존 규제 기관이 AI를 관리하는 기관이라는 점에서도 마찬가지로 회의적이었다. 대신 연구 기관, 대학, 국방부가 이 분야에서 가장 유능한 기관으로 여겼다.

설문조사에 따르면, 주 정부에 대해 회의적인 입장을 보였지만, 유엔과 같은 초국가적 기관에 대해서는 보다 긍정적으로 생각했다. 스태티스타에 따르면, 유럽위원회(The European Commission)가 현재 이 범주에서 AI의 영향력을 억제하고 개인의 권리를 보호하는 것을 목표로 하는 법률 초안을 마련한 유일한 기관이다. 이른바 AI 법안은 2021년 4월에 제안되었지만, 아직 채택되지 않았다. 제안된 법안은 AI 애플리케이션을 다양한 위험 범주로 분류한다. 예를 들어, 여론을 조작하거나 어린이 또는 취약 계층을 대상으로 수익을 창출하는 AI는 EU에서 불법이 될 수 있다. 생체 인식 데이터 소프트웨어와 같은 고위험 애플리케이션은 엄격한 법적 규제를 받게 된다. 전문가들은 이 정책 초안에 명백한 허점과 모호한 정의가 있다고 비판했다고 스태티스타는 지적했다.

미국에서는 조 바이든 대통령이 2022년 10월 AI 권리장전이라는 청사진을 발표했다. 백악관 과학기술정책국(OSTP)은 공개한 ‘AI 권리장전(AI Bill of Rights)’ 청사진에서 ▲안전하고 효과적인 시스템(Safe and Effective Systems) ▲알고리즘차별 방지(Algorithmic Discrimination Protections) ▲데이터 사생활 보호(Data Privacy) ▲사전 고지와 설명(Notice and Explanation) ▲인적 대안 및 대비책(Human Alternatives, Consideration, and Fallback) 등 기업과 정부 기관들이 지켜야 할 5가지 기본 원칙을 공개했다. 백악관은 “지난 1년간 24개의 정부 부처 및 테크 기업들과 협의를 거친 뒤 이 같은 원칙을 마련했다”고 밝혔다. 그러나 이름과는 달리 AI 권리장전은 비규제적이고 구속력이 없다. 현재 미국에는 AI 규제에 관한 연방법이나 구속력 있는 특정 정책이 존재하지 않다.